- In:

- Posted By: Capuano Edoardo

- Commenti: 0

Gli scienziati dimostrano che una grande rete neurale può elaborare sequenze consumando da quattro a sedici volte meno energia durante l'esecuzione su hardware neuromorfico.

L'hardware neuromorfico basato su Spike promette implementazioni più efficienti dal punto di vista energetico delle reti neurali profonde (DNN) rispetto all'hardware standard come le GPU. Ma questo ci richiede di capire come i DNN possono essere emulati in un regime di sparo basato sugli eventi, altrimenti il vantaggio energetico viene perso. In particolare, i DNN che risolvono le attività di elaborazione delle sequenze in genere utilizzano unità di memoria a breve termine lunghe che sono difficili da emulare con pochi picchi.

Per la prima volta l'Institute of Theoretical Computer Science e Intel Labs di TU Graz hanno dimostrato sperimentalmente che una grande rete neurale può elaborare sequenze, come ad esempio delle frasi, consumando da quattro a sedici volte meno energia durante l'esecuzione su hardware neuromorfico rispetto a hardware non neuromorfo. La nuova ricerca basata sul chip di ricerca neuromorfico Loihi di Intel Labs che attinge alle intuizioni delle neuroscienze per creare chip che funzionano in modo simile a quelli del cervello biologico.

La ricerca è stata finanziata da The Human Brain Project (HBP), uno dei più grandi progetti di ricerca al mondo con oltre 500 scienziati e ingegneri in tutta Europa che studiano il cervello umano. I risultati della ricerca sono pubblicati nel documento di ricerca “Memory for AI Applications in Spike-based Neuromorphic Hardware” che è stato pubblicato su Nature Machine Intelligence. (1)

Il cervello umano come modello

Macchine intelligenti e computer intelligenti in grado di riconoscere e dedurre autonomamente oggetti e relazioni tra oggetti diversi sono oggetto di ricerca mondiale sull'intelligenza artificiale (AI). Il consumo di energia è un ostacolo importante sulla strada per una più ampia applicazione di tali metodi di intelligenza artificiale. Si spera che la tecnologia neuromorfica fornisca una spinta nella giusta direzione. La tecnologia neuromorfica è modellata sul cervello umano, che è altamente efficiente nell'uso dell'energia. Per elaborare le informazioni, i suoi cento miliardi di neuroni consumano solo circa 20 watt, non molta più energia di una lampadina media a risparmio energetico.

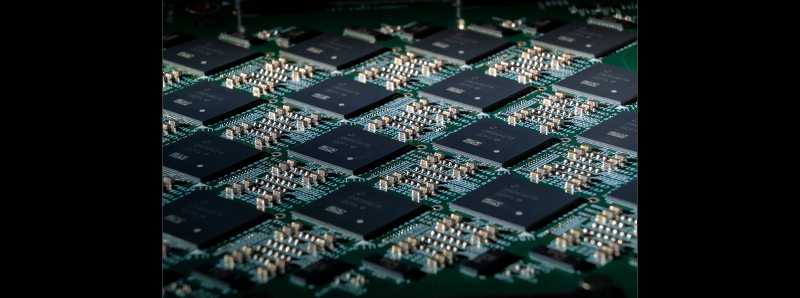

Nella ricerca, il gruppo si è concentrato su algoritmi che funzionano con processi temporali. Ad esempio, il sistema doveva rispondere a domande su una storia raccontata in precedenza e cogliere le relazioni tra oggetti o persone dal contesto. L'hardware testato consisteva in 32 chip Loihi.

Chip di ricerca Loihi: fino a sedici volte più efficiente dal punto di vista energetico rispetto all'hardware non neuromorfo

Il dottor Philipp Plank, uno studente di dottorato presso l'Istituto di informatica teorica della Graz University of Technology, afferma: «Il nostro sistema è da quattro a sedici volte più efficiente dal punto di vista energetico rispetto ad altri modelli di intelligenza artificiale su hardware convenzionale. Egli prevede ulteriori incrementi di efficienza man mano che questi modelli vengono migrati alla prossima generazione di hardware Loihi, che migliora significativamente le prestazioni della comunicazione da chip a chip».

Il dottor Mike Davies, direttore del Neuromorphic Computing Lab di Intel, dice: «I chip di ricerca Loihi di Intel promettono vantaggi nell'Intelligenza Artificiale, soprattutto riducendo il loro elevato costo energetico. Il nostro lavoro con la Graz University of Technology fornisce ulteriori prove del fatto che la tecnologia neuromorfica può migliorare l'efficienza energetica degli odierni carichi di lavoro di deep learning ripensando alla loro implementazione dal punto di vista della biologia».

Imitando la memoria umana a breve termine

Nella loro rete neuromorfica, il gruppo ha riprodotto un presunto meccanismo di memoria del cervello, come spiega Wolfgang Maass, (2) supervisore del dottorato di Philipp Plank presso l'Institute of Theoretical Computer Science: «Studi sperimentali hanno dimostrato che il cervello umano può immagazzinare informazioni per un breve periodo di tempo anche senza attività neurale, cioè nelle cosiddette 'variabili interne' dei neuroni. Le simulazioni suggeriscono che un meccanismo di affaticamento di un sottoinsieme di neuroni è essenziale per questa memoria a breve termine».

Manca una prova diretta perché queste variabili interne non possono ancora essere misurate, ma significa che la rete deve solo testare quali neuroni sono attualmente affaticati per ricostruire quali informazioni ha elaborato in precedenza. In altre parole, le informazioni precedenti vengono memorizzate nella non attività dei neuroni e la non attività consuma meno energia.

Simbiosi di rete ricorrente e feed-forward

I ricercatori collegano due tipi di reti di apprendimento profondo per questo scopo. Le reti neurali di feedback sono responsabili della “memoria a breve termine”. Molti di questi cosiddetti moduli ricorrenti filtrano possibili informazioni rilevanti dal segnale di ingresso e le memorizzano. Una rete feed-forward determina quindi quali delle relazioni trovate sono molto importanti per risolvere il compito in questione. Le relazioni prive di significato vengono escluse, i neuroni si attivano solo in quei moduli in cui sono state trovate informazioni rilevanti. Questo processo alla fine porta al risparmio energetico.

«Si prevede che le strutture neurali ricorrenti forniranno i maggiori vantaggi per le applicazioni in esecuzione su hardware neuromorfico in futuro», ha affermato Davies. «L'hardware neuromorfo come Loihi è particolarmente adatto per facilitare i modelli veloci, scarsi e imprevedibili di attività di rete che osserviamo nel cervello e che necessitano delle applicazioni di intelligenza artificiale più efficienti dal punto di vista energetico».

Questa ricerca è stata sostenuta finanziariamente da Intel e dallo European Human Brain Project, che collega le neuroscienze, la medicina e le tecnologie ispirate al cervello nell'UE. A tal fine, il progetto sta creando un'infrastruttura di ricerca digitale permanente, EBRAINS. Questo lavoro di ricerca è ancorato nei campi di competenza umana e biotecnologia e informazione, comunicazione e informatica, due dei cinque campi di competenza di TU Graz.

Riferimenti:

(1) A Long Short-Term Memory for AI Applications in Spike-based Neuromorphic Hardware

(2) Wolfgang Maass

Descrizione foto: Una delle schede Nahuku di Intel, ognuna delle quali contiene da 8 a 32 chip neuromorfici Intel Loihi. - Credit: Tim Herman/Intel Corporation.

Autore traduzione riassuntiva e adattamento linguistico: Edoardo Capuano / Articolo originale: Tu graz und intel demonstrieren signifikante energieeinsparungen durch neuromorphe hardware