- In:

- Posted By: Veronica Pesenti

- Commenti: 0

I ricercatori hanno creato un dispositivo indossabile che può leggere la mente delle persone quando usano una voce interiore, permettendo loro di controllare dispositivi e fare domande senza parlare.

I ricercatori hanno creato un dispositivo indossabile che può leggere la mente delle persone quando usano una voce interiore, permettendo loro di controllare dispositivi e fare domande senza parlare.

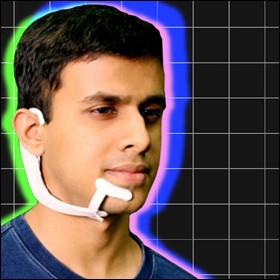

Il dispositivo, chiamato AlterEgo, può trascrivere parole che gli utilizzatori verbalizzano internamente ma non pronunciano ad alta voce, tramite elettrodi attaccati alla pelle.

“La nostra idea era: possiamo avere una piattaforma informatica che sia più interiore, che fonda umano e macchina e che sembri un’estensione interna della nostra cognizione?”, ha dichiarato Arnav Kapur, che ha guidato lo sviluppo del sistema al laboratorio multimediale del MIT.(1)

La cuffia viene descritta da Kapur come una “intelligenza-aumentata” o IA, ed è stata presentata durante la conferenza Intelligent User Interface dell’Associazione per Macchinari Informatici a Tokyo.(2)

Si indossa intorno alla mandibola e al collo e si chiude sopra l’orecchio per fissarla in posizione. Quattro elettrodi sotto la plastica bianca fanno contatto con la pelle e percepiscono i sottili segnali neuromuscolari che vengono innescati quando una persona verbalizza interiormente. Quando qualcuno pronuncia parole dentro la propria testa, l’intelligenza artificiale attraverso il dispositivo riesce ad abbinare determinati segnali a determinate parole, passandole in un computer.

Il computer può poi rispondere attraverso il dispositivo usando uno speaker a conduzione ossea che riproduce il suono direttamente all’interno dell’orecchio senza bisogno di indossare una cuffietta, permettendo così di poter ascoltare il resto del mondo contemporaneamente. L’idea è quella di creare un’interfaccia del computer silenziosa all’esterno con la quale solo chi indossa Alter Ego può parlare e sentire.

“Ormai non possiamo più vivere con i nostri cellulari, i nostri dispositivi digitali. Ma al momento, l’utilizzo di suddetti dispositivi è disturbante,” ha detto Pattie Maes,(3) una docente di arti e scienze dei media al MIT. “Se voglio controllare qualcosa che è rilevante per la conversazione che sto avendo, devo trovare il mio cellulare e digitare il codice d’accesso e aprire un’app e digitare le parole chiave per la ricerca, e il processo richiede che io sposti l’attenzione dall’ambiente circostante e le persone con cui sono al cellulare stesso.”

Maes e i suoi studenti, incluso Kapur, hanno sperimentato nuovi fattori e interfacce per fornire la conoscenza e i servizi degli smartphone senza l’interruzione intrusiva che causano attualmente nel quotidiano.

Il dispositivo AlterEgo è riuscito a garantire un’accuratezza delle trascrizioni fino al 92% in un esperimento su 10 persone con circa 15 minuti di personalizzazione su ogni soggetto. È un risultato di pochi punti inferiore al 95% di accuratezza di cui è capace il servizio di trascrizione vocale di Google, che utilizza un microfono tradizionale, ma Kapur sostiene che il sistema migliorerà l’accuratezza con il tempo. La soglia di accuratezza umana della parola vocale è pensata intorno al 95%.

Kapur e il suo team stanno al momento lavorando sulla raccolta dati per migliorare il riconoscimento e aumentare il numero di parole che Alter Ego può captare. Può già essere usato per controllare un’interfaccia essenziale come il sistema di streaming Roku, muovere e selezionare i contenuti, e può riconoscere i numeri, giocare a scacchi e svolgere altre semplici attività.

L’obiettivo successivo sarebbe quello di fare interfacciare gli assistenti AI come quelli di Google, Amazon o Apple in modo più intimo e meno imbarazzante, permettendo alle persone di comunicare con questi in modo silenzioso.

L’unico lato negativo è che gli utenti dovrebbero indossare un dispositivo fissato alla faccia, una barriera che altri dispositivi come i Google Glass non sono riusciti a superare. Gli esperti però pensano che la tecnologia abbia molto potenziale, non solo in un consumo per attività come la dettatura ma anche nell’industria.

“Non sarebbe grandioso comunicare a voce in un ambiente in cui solitamente non riusciresti?” ha detto Thad Starner, un docente di informatica della Georgia Tech. “Puoi immaginarti tutte quelle situazioni in cui hai un ambiente altamente rumoroso, come il ponte di volo di una portaerei, o anche posti con molti macchinari, come una centrale elettrica o una stamperia.”

Starner vede anche un’applicazione nel campo militare e per quelle condizioni che non consentono di parlare normalmente.

Riferimenti:

(1) Computer system transcribes words users “speak silently”

(2) ACM IUI 2018 - Tokyo, Japan March 7-11, 2018

(3) Overview ‹ Pattie Maes — MIT Media Lab

Articolo originale del The Guardian: Just an hour of exercise a week could prevent depression, study finds / Foto di pixabay.com / Traduzione e adattamento linguistico: Veronica Pesenti